”模型压缩 剪枝“ 的搜索结果

你想让你大模型在不掉太多精度的前提下,进一步提升速度嘛,走过路过不要错过,手把手教你实现模型压缩中的剪枝操作。

PaddleSlim是百度提出的模型优化工具,包含在PaddlePaddle框架中,支持若干知识蒸馏算法,可以在teacher网络和student网络任意层添加组合loss,包括FSP loss,L2 loss,softmax with cross-entropy loss等。...

为了解决这些问题,压缩模型以最大限度地减小模型对于计算空间和时间的消耗。 2.理论基础 必要性:目前主流的网络,如VGG16,参数量1亿3千多万,占用500多MB空间,需要进行300多亿次浮点运算才能完成一次图像...

基于多种模型剪枝方法(L1-norm、Slimming、AutoSlim)的模型轻量化和模型压缩实现

自己整理的剪枝和模型压缩论文合集自己整理的剪枝和模型压缩论文合集自己整理的剪枝和模型压缩论文合集自己整理的剪枝和模型压缩论文合集自己整理的剪枝和模型压缩论文合集自己整理的剪枝和模型压缩论文合集自己整理...

1,CNN模型压缩综述 1 模型压缩的必要性及可行性 (1)必要性:首先是资源受限,其次在许多网络结构中,如VGG-16网络,参数数量1亿3千多万,占用500MB空间,需要进行309亿次浮点运算才能完成一次图像识别任务; ...

参考综述文章 * 2017-A Survey of Model Compression and Acceleration for Deep Neural Networks * 2018-Recent Advances in Efficient Computation of Deep Convolutional Neural Networks 参考博客: ...

深度学习模型计算复杂度高,参数存在冗余。(1)线性或非线性量化。 (2)结构或非结构剪枝。 (3)网络结构搜索。 (4)权重矩阵的低秩分解。(蒸馏)优化精度、性能、存储等,使得可以在一些场景和设备上进行相应...

人工智能-项目实践-模型压缩-模型压缩demo(剪枝、量化、知识蒸馏) 模型压缩demo(剪枝、量化、知识蒸馏)

prune.l1_unstructured(module, name="weight", amount=nWeightAmcount) #L1范数剪枝,既绝对值最小的权重移除prune.ln_structured(module, name="weight", amount=nFeatureAmcount, n=2, dim=0) #结构化剪枝,移除...

被压缩后的模型计算资源需求和内存需求更小,相比原始模型能够满足更加广泛的应用需求。剪枝方法探索模型权重中的冗余, 并尝试删除/修剪冗余和非关键的权重。剪枝分为结构化剪枝和非结构化剪枝,两者区别在于是否会...

稀疏剪枝

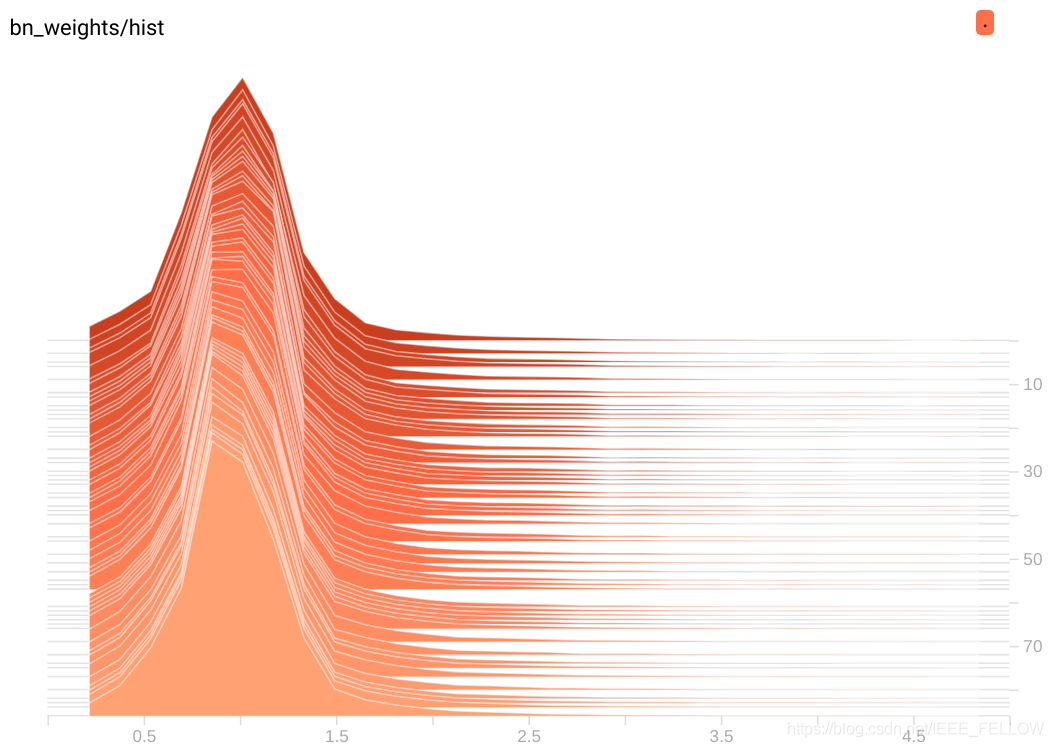

这篇文章是ICCV 2017的一篇模型压缩论文,题目为《 Learning Efficient Convolutional Networks through Network Slimming》。2019年有相当多的关于YOLOv3的剪枝开源工程,他们大多数的原理都来自于这篇论文,这篇...

YOLOv3-手部检测-训练测试-模型剪枝-模型压缩

比较复杂的模型往往有着不错的识别效果,但是复杂的模型往往对算力要求也比较高,在一些对于实时性要求比较高或者算力比较小的应用场景中,这时复杂的模型往往不能很好达到预期效果,这时候就要进行模型的剪枝,提高...

模型压缩的方法中,包括剪枝,量化,多值网络,模型蒸馏等。其中剪枝的方法,应用的更多,此篇文章主要就说剪枝。剪枝最初是在决策树学习算法中,用于对付“过拟合”的主要手段。因为在决策树学习中,为了尽可能正确...

考虑到这一点,为了减少内存、容量和硬件消耗,同时又不牺牲模型预测的精度,在设备上部署轻量级模型,并通过私有的设备上计算以保证隐私,通过减少参数数量来压缩模型的最佳技术非常重要。 稀疏神经网络在预测精度...

考虑到这一点,为了减少内存、容量和硬件消耗,同时又不牺牲模型预测的精度,在设备上部署轻量级模型,并通过私有的设备上计算以保证隐私,通过减少参数数量来压缩模型的最佳技术非常重要。 稀疏神经网络在预测精度...

而模型压缩算法可以将一个庞大而复杂的预训练模型转化为一个精简的小模型,从而减少对硬件的存储、带宽和计算需求,以达到加速模型推理和落地的目的。数值量化(Data Quantization,也叫模型量化)模型稀疏化(Model...

模型剪枝,高效压缩模型的简单实现

推荐文章

- 高速缓冲存储器cache介绍_c6713的第一级程序高速缓冲和第一级数据高速缓冲容量都是8kb,第一级存储器/高速缓冲的容量为32-程序员宅基地

- C语言资料文章目录合集-程序员宅基地

- LeetCode #566 - Reshape the Matrix__%#:566-程序员宅基地

- UserWarning: Workbook contains no default style, apply openpyxl‘s default warn no default style 解决方案-程序员宅基地

- c++中类成员函数的相互调用_c++类的成员函数调用其他成员函数-程序员宅基地

- Window Linux双系统安装 超详细教程_windows linux双系统-程序员宅基地

- Unity 模型涂鸦-程序员宅基地

- qt使用q3dsurface绘制三维曲面图-程序员宅基地

- bapi清单_sap me01 me04货源清单 bapi-程序员宅基地

- 【C++ 项目设计】深入JSON处理与项目实践:C++中的高效设计与应用-程序员宅基地